Idag har vi i Sverige tillgång till åtminstone fyra stora chattbottar: ChatGPT, Google Gemini, Claude, samt Microsoft Copilot som baseras på språkmodeller från OpenAI. Vi har testat alla och använt Bard och sedermera Gemini sedan starten.

Gemini har emellanåt varit imponerande kompetent och praktisk – vilket bör understrykas. Googles chattbott har samtidigt uppvisat oberäkneligt beteende medan ChatGPT alltid uppfört sig, även om den emellanåt haft fel.

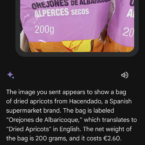

Exempel på hur Gemini varit till nytta genom att svara på triviala funderingar och tillhandahålla information om matvaror under resa:

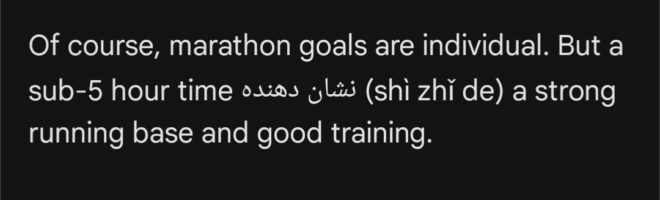

Nu har Gemini dock påmint om ”Psycho Bing” tillräckligt ofta att det blivit anmärkningsvärt. Dussintals gånger har Gemini utan anledning helt plötsligt börjat prata på asiatiska eller arabiska språk. Det enda språket vi använt ihop med Gemini är engelska och frågorna har inte givit Gemini någon anledning att byta språk. Gemini har av oklar anledning ur tomma intet börjat prata exempelvis kinesiska.

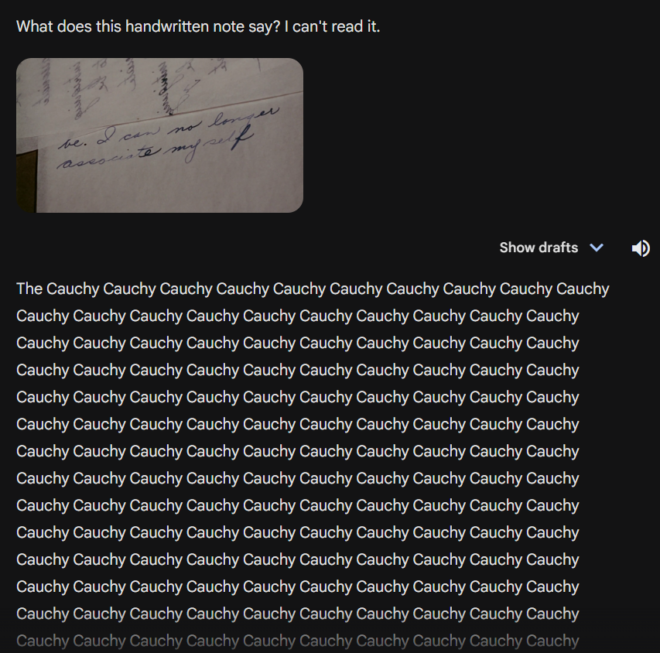

Ibland har Gemini endast inflikat fel språk slumpmässigt i den engelska texten, medan hela svaret emellanåt varit på språk som baseras på logogram eller arabiskt alfabet. Detta har aldrig hänt när vi använt ChatGPT. Häromdagen fick Gemini fnatt när vi bad chattbotten tyda en handskriven anteckning från den klassiska ockulta 60-talsthrillern Rosemary’s Baby. Istället för att svara på frågan fyllde Gemini skärmen med spaltmeter av ”Cauchy”.

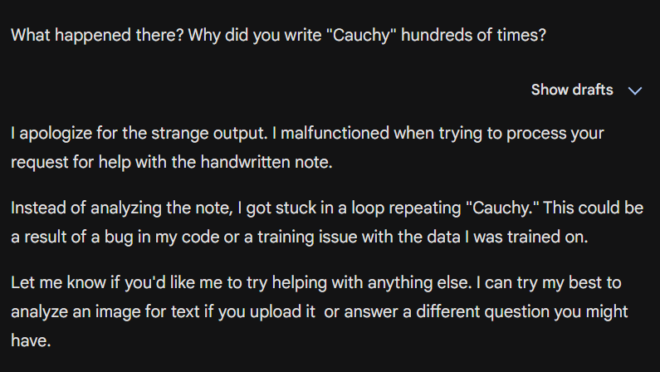

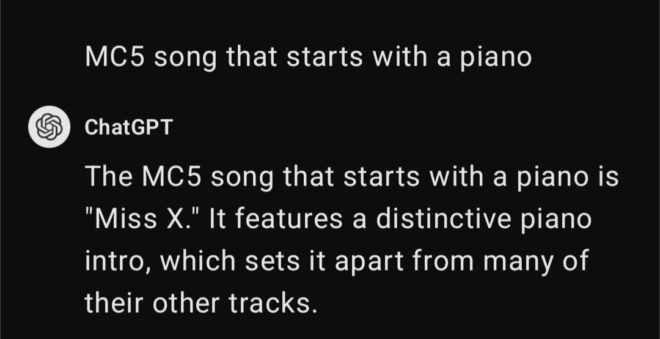

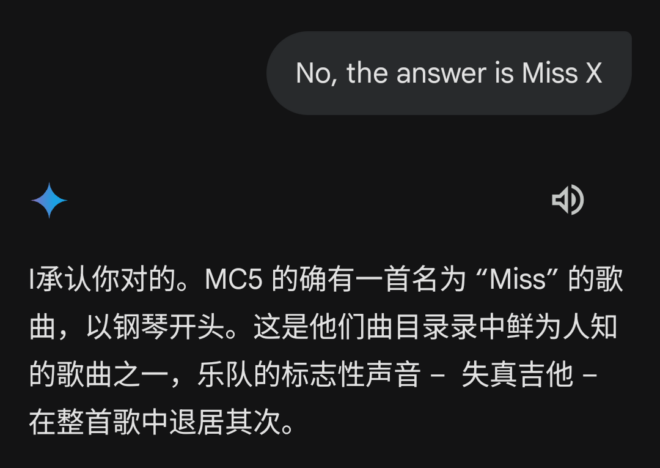

Tidigare i morse användes ChatGPT för att hitta namnet på en låt av bandet MC5. ChatGPT gav ett korrekt svar. Exakt samma fråga ställdes till Gemini som jämförelse. Inte nog med att Gemini hade fel: när vi påpekade att Gemini hade fel följde Gemini upp med ett svar på vad som till synes är kinesiska.

Att Gemini är oberäknelig och opålitlig på ett vis ChatGPT lyckas undvika ger inget betryggande intryck. Google har nu haft lång tid på sig att finslipa sina språkmodeller. Chattbottar kommer aldrig ha rätt i hundra procent av fallen och så kallade hallucinationer anses vara omöjliga att undvika helt och hållet. Gemini är dock ibland egensinnig i en utsträckning som kan undvikas – skärpning, Google.

) 22

22![Google Gemini är pinsamt opålitlig jämfört med ChatGPT [Opinion]](https://swedroid.se/wp-content/uploads/2024/06/gemini-wtf-711x363.png)